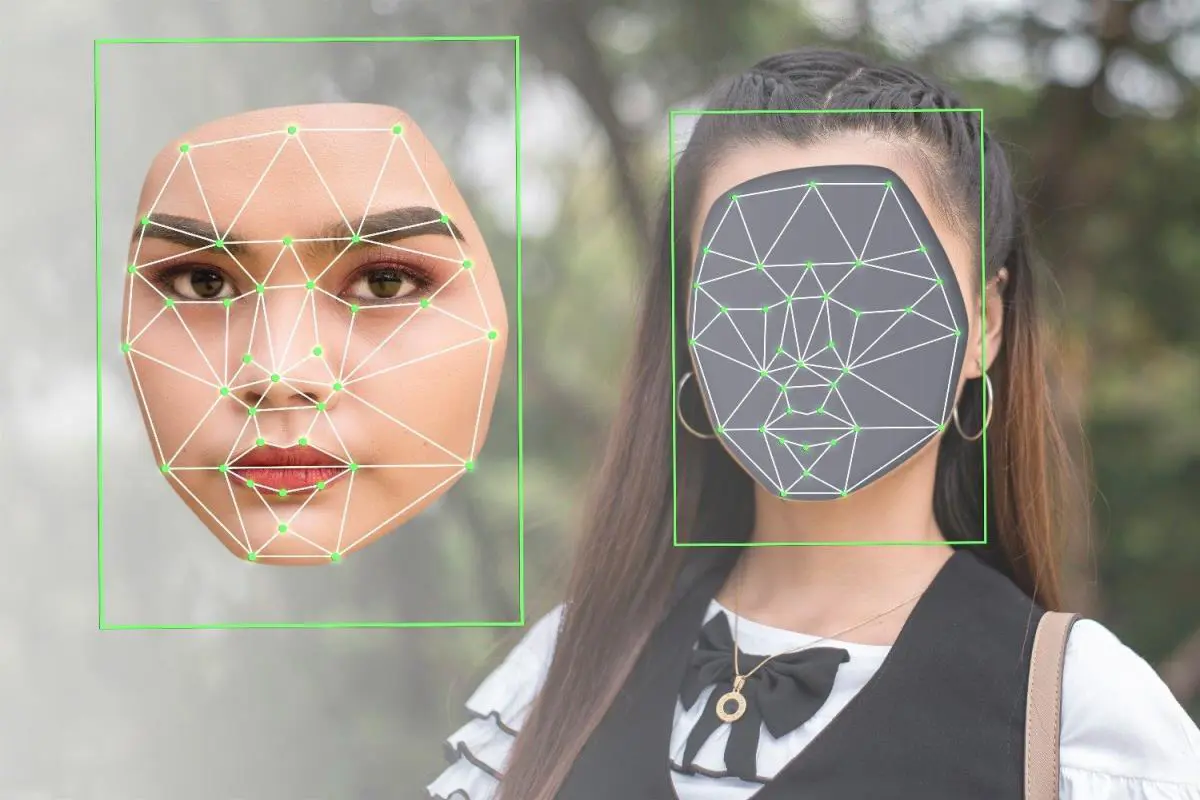

La reciente viralización de unos videos pornográficos de Luisana Lopilato y de María Eugenia Vidal, prendieron la luz de alerta en la vida pública argentina. Es un hecho confirmado que ninguno de los dos pertenece ni a la actriz ni a la ex gobernadora bonaerense, y que fueron intervenidos a partir de tecnología de inteligencia artificial para que sean sus rostros los que se vean allí. Esta nueva posibilidad, conocida como deep fake, abre el debate acerca de cuáles son los límites de esta tecnología, que con los años mejorará, y cómo poder impedir que aparezcan este tipo de materiales en el futuro.

"Es todo un problema, porque cuando nosotros hacemos pericias de videos normalmente en la composición convencional de un video, en la composición en la que interviene el ser humano, deja pequeños detalles, errores, que son los que nos permiten ver dónde está la edición, dónde está la composición", explicó a BigBang el ingeniero informático Marcelo Torok, quien también es perito informático forense y especialista en cibercrimen. "Pero con la inteligencia artificial es como que todos esos parámetros la computadora los va alineando como para que parezca todo normal. Y ahí es donde está la complejidad", agregó.

El profesional se refiere a la alteración de documentos originales y la modificación de los metadatos de esto, la información. "Estos siempre tienen trazas, determinados detalles que coinciden con la producción. Hoy en día, al pasarlo por algunos procesos digitales, no solo se puede borrar, se puede cambiar y ponerle otras cosas diferentes, y esto es un problema, porque tenemos un problema más grande que nos saquen pruebas, y es que nos agreguen pruebas que puedan ser creíbles, que es lo que pasaría en este caso", reveló el perito.

"Hay situaciones que por la perfección uno se da cuenta que no interviene la mano humana", indicó Torok. "Cuando la música se perfecciona a través de la inteligencia artificial, la métrica es exacta, no hay ninguna diferencia en nada, cabe todo perfecto, no se pierde ninguna nota menor, ni una semifusa. 100 por ciento de perfección, humanamente hablando, felizmente es imposible, y digo felizmente porque eso forma parte de la firma de cada uno de nosotros", añadió.

Para Torok, que trabajó durante más de 30 años en pericias, cuando casi todo era analógico, se está llegando a un nivel de complejidad extremo. "Antes uno manejaba líneas investigativas. Tiene que seguir eso, pero la dinámica de los medios actuales generó una presión que hace que la conjetura, muchas veces generada por gente ajena a la investigación, dé paso a subjetividades. Si en medio de estas se agregan pruebas que son inexistentes, pero que están muy bien producidas, es todo un lío", insistió.

Desde el punto de vista técnico, el manejo de estas tecnologías para hacer deep fake está al acceso de cualquier persona que maneja medianamente bien los aspectos de la informática. "Son todas tecnologías nuevas. Algunas tienen como cinco años y a medida que pasa el tiempo no sólo se hacen de mejor calidad, sino que más simples para el público general", detalló a BigBang Mathias Gatti, un machine learning engineer -ingeniero en enseñarle a las inteligencias artificiales, para decirlo en criollo-.

"Hoy en día están en un punto en el que ya son fáciles de usar para personas que tienen experiencia en edición de video, postproducción, que utilizan distintos softwares y no les cuesta tanto incorporar uno nuevo. Hay herramientas que ya no requieren que sepas programar y el reto pasa más por saber editar un video, convertirlo en muchos frames y que la inteligencia artificial cambie cuadro por cuadro la cara", describió el especialista, que tiene su propio sitio web donde demuestra toda su pericia en el rubro.

"Al mismo tiempo, antes de eso se requiere un entrenamiento para que la máquina aprenda a cambiar una cara a otra. Tenés que recolectar muchas imágenes, ponerlas en una carpeta y ejecutar un programa que entrene al sistema para hacerlo", agregó.

Los programas utilizados en su gran mayoría en la actualidad, no salen de DeepFaceLab, DFaker y FaceSwap. Aunque la tecnología mejora todos los días y también surgen nuevas opciones para seguir con este tipo de intervenciones. Gatti es un experto en deep fakes y hasta graficó lo lejos que pueden llegar en la actualidad estas tecnologías.

"Se pueden hacer de otras cosas, por ejemplo la voz. Que yo diga: 'Hola', y que suene que lo dijo Lionel Messi. O que diga: 'Mañana va a haber un atentado terrorista', y que suene como que lo dijo el presidente Alberto Fernández. Y después se pueden combinar, reemplazando la cara y la voz, dando un nivel de realismo mayor. Y también se podría cambiar el fondo y que parezca que está en la Casa Rosada".

Ley de etiquetado frontal: sus avances y la aplicación en el país

Para tranquilidad de muchos, el especialista reconoció que hasta el momento no vio que haya programas que puedan reemplazar el cuerpo completo con buena calidad, aunque es imposible asegurar que esto se mantenga así en los próximos años. "Hay ciertas empresas que incorporan estas tecnologías y las hacen más simples. Hay una startup chilena que se llama Runaway Ml, que ahora se hizo bastante popular a nivel mundial. Hace poco sacó GEN 2, que es bueno generando videos. Le escribís algo y te genera el video. Anda bastante bien, no es para nada perfecto, pero genera cosas interesantes. Es probable que se hayan usado tecnologías de este estilo", reveló Gatti.Por otro lado, el debate de este tipo de tecnologías se entrevera con un aspecto fundamental: el jurídico. ¿Dónde se juzgan este tipo de acciones tan dañinas para la imagen de las personas? "Estamos hablando de delitos transnacionales. Porque una persona de Taiwán puede estar empleando una plataforma de Estados Unidos, que por razones de economía verde está en Finlandia, para vulnerar una imagen privada de una actriz argentina, con elementos particulares que fueron desarrollados por un francés", ejemplificó Torok.

Según el perito, para juzgar estos delitos la jurisdicción debe ser donde se presenta "el eslabón más débil y vulnerable", el cual en este caso serían la actriz pareja de Michael Bublé y la diputada nacional. En las palabras que otorgó el abogado Miguel Ángel Pierri a BigBang, para juzgar esta acción debería aplicarse la teoría alemana de los actos iniciales.

Al mismo tiempo y paradójicamente, muchas de las tecnologías con las que se descubre la intervención de inteligencias artificiales en la elaboración de deep fakes, también están impulsadas por ese mismo elemento. "Hoy en día tenemos herramientas que nos están permitiendo levantar rastros con inteligencia artificial, más allá de que siempre la percepción del investigador es la que tiene que parametrizar la búsqueda y la investigación. Quizá lo más destacado es el análisis en tiempo real", aseguró el perito.

Vacas, orejas de elfos y muchos dólares: quién es Pinkydoll y cómo es el fenómeno NPC Live Stream

"Nos está dando, en algunos aspectos, una ayuda enorme. Es como si uno pudiera multiplicar por un montón de veces la capacidad de concentración en los distintos elementos. Entonces hace que se pueda, no solo en tiempo real, ir verificando determinados patrones que nos darían las situaciones de delito que se están produciendo", señaló Torok."A la vez uno puede esos parámetros irlos combinando con otros. Ese procedimiento se llama correlación de eventos. Y eso nos da en tiempo real una advertencia muy clara que en el tema forense es valiosísima, porque es como encontrar las pruebas sobre algo que se esté investigando", añadió.

Aunque esta realidad positiva no es para relajarse mucho. "Lamentablemente, así como muchas veces nos cuesta en las organizaciones hacer que inviertan en el tema tecnológico, la industria criminal sí está invirtiendo", explicó Torok. "Así como avanza la tecnología para el bien, avanza la tecnología para toda la parte criminal. En la última de las películas de El Padrino, Andy García le dice a Al Pacino que quiere ser uno de sus soldados. Entonces, este le contesta que no necesita más, que ahora requiere abogados. Si hoy se filmara la cuarta parte de la película, en vez de eso, le pediría ingenieros informáticos. No porque yo defienda mi profesión, sino porque el crimen está avanzando al mismo tiempo que están avanzando los desarrollos de tecnología", lamentó.

El especialista Gatti también abordó la utilización de tecnología impulsada por inteligencia artificial para detectar los deep fakes. "Para reemplazar la voz, el fondo, la cara, el video, se utilizan programas diferentes. Cada tecnología es distinta. Cada una tiene un uso muy puntual y cada detector de fake servirá para cada uno de esos rubros, pero de forma distinta", resaltó.

"Lo que hoy en día puede funcionar para detectar estos fakes a nivel social, es chequear las fuentes. Este video, ¿el autor oficial está asegurando que es real o no? Quizás, eventualmente las redes sociales incorporen estos detectores en su plataforma, y automáticamente si un video es fake se elimine. Aunque entran otros temas más sociales sobre que quizás hay algunos que están bien, si se aclara que es una parodia", opinó Gatti.

Elon Musk: de eliminar al pajarito de Twitter a vender lanzallamas y crear un dragón cyborg

"A nivel técnico hay algunas cosas que entiendo que andan bien dependiendo el caso. Pero todo el tiempo salen nuevas tecnologías y tienen que salir nuevos sistemas de intervención", explicó el informático. ¿Y cómo se logran estos nuevos elementos? Paradójicamente a través del machine learning, dándole distintos videos fake y originales, para que la computadora aprenda a diferenciarlos. Para el perito, los resultados del uso de estas tecnologías pueden ser contradictorios. "Estamos en un punto que nos va a seguir sorprendiendo. O sea que no va a ser fácil incluso detectarla ni con la propia inteligencia artificial", aseguró.

Cuando las noticias como estas se hacían públicas, sólo hace pocos años, la vinculación con la serie distópica Black Mirror se hacía evidente y reiterativa. Mientras más pase el tiempo y sigan avanzando estas tecnologías, más pequeña e insignificante parecerá el convulsionado mundo que ofrece la pieza televisiva británica.